Robots.txt கோப்பு என்றால் என்ன? எஸ்சிஓவிற்கான ரோபோட் கோப்பை எழுத, சமர்ப்பிக்க மற்றும் மீண்டும் வலம் வர வேண்டிய அனைத்தும்

நாங்கள் ஒரு விரிவான கட்டுரையை எழுதியுள்ளோம் தேடுபொறிகள் உங்கள் இணையதளங்களை எவ்வாறு கண்டுபிடித்து, வலைவலம் செய்து, அட்டவணைப்படுத்துகின்றன. அந்த செயல்பாட்டில் ஒரு அடிப்படை படியாகும் robots.txt கோப்பு, உங்கள் தளத்தை வலைவலம் செய்வதற்கான தேடுபொறிக்கான நுழைவாயில். தேடுபொறி உகப்பாக்கத்தில் robots.txt கோப்பை எவ்வாறு சரியாக உருவாக்குவது என்பதைப் புரிந்துகொள்வது அவசியம் (எஸ்சிஓ).

இந்த எளிய மற்றும் சக்திவாய்ந்த கருவி, தேடுபொறிகள் தங்கள் வலைத்தளங்களுடன் எவ்வாறு தொடர்பு கொள்கின்றன என்பதைக் கட்டுப்படுத்த வெப்மாஸ்டர்களுக்கு உதவுகிறது. தேடுபொறி முடிவுகளில் இணையதளத்தின் திறமையான அட்டவணைப்படுத்தல் மற்றும் உகந்த தெரிவுநிலையை உறுதிசெய்வதற்கு, robots.txt கோப்பைப் புரிந்துகொள்வதும் திறம்படப் பயன்படுத்துவதும் அவசியம்.

Robots.txt கோப்பு என்றால் என்ன?

robots.txt கோப்பு என்பது இணையதளத்தின் ரூட் டைரக்டரியில் உள்ள உரைக் கோப்பு. தளத்தின் எந்தப் பகுதிகளை வலம் வர வேண்டும் அல்லது எந்தெந்தப் பகுதிகளை வலம் வர வேண்டும் அல்லது அட்டவணைப்படுத்த வேண்டும் என்பதைப் பற்றி தேடுபொறி கிராலர்களுக்கு வழிகாட்டுவதே இதன் முதன்மை நோக்கமாகும். கோப்பு ரோபோக்கள் விலக்கு நெறிமுறையைப் பயன்படுத்துகிறது (REP), ஒரு நிலையான வலைத்தளங்கள் வலை கிராலர்கள் மற்றும் பிற வலை ரோபோக்களுடன் தொடர்புகொள்வதற்குப் பயன்படுத்துகின்றன.

REP என்பது அதிகாரப்பூர்வ இணைய தரநிலை அல்ல, ஆனால் பெரிய தேடுபொறிகளால் பரவலாக ஏற்றுக்கொள்ளப்பட்டு ஆதரிக்கப்படுகிறது. Google, Bing மற்றும் Yandex போன்ற முக்கிய தேடுபொறிகளின் ஆவணங்கள் ஏற்றுக்கொள்ளப்பட்ட தரநிலைக்கு மிக நெருக்கமானவை. மேலும் தகவலுக்கு, பார்வையிடவும் Google இன் Robots.txt விவரக்குறிப்புகள் பரிந்துரைக்கப்படுகிறது.

Robots.txt எஸ்சிஓவிற்கு ஏன் முக்கியமானது?

- கட்டுப்படுத்தப்பட்ட ஊர்தல்: Robots.txt இணையதள உரிமையாளர்கள் தங்கள் தளத்தின் குறிப்பிட்ட பகுதிகளை தேடுபொறிகள் அணுகுவதைத் தடுக்க அனுமதிக்கிறது. நகல் உள்ளடக்கம், தனிப்பட்ட பகுதிகள் அல்லது முக்கியத் தகவல் கொண்ட பிரிவுகளைத் தவிர்த்து இது மிகவும் பயனுள்ளதாக இருக்கும்.

- உகந்த வலைவல பட்ஜெட்: தேடுபொறிகள் ஒவ்வொரு வலைத்தளத்திற்கும் ஒரு வலைவல பட்ஜெட்டை ஒதுக்குகின்றன, ஒரு தேடுபொறி போட் ஒரு தளத்தில் வலம் வரும் பக்கங்களின் எண்ணிக்கை. பொருத்தமற்ற அல்லது குறைவான முக்கியத்துவம் வாய்ந்த பிரிவுகளை அனுமதிக்காததன் மூலம், robots.txt இந்த வலைவல பட்ஜெட்டை மேம்படுத்த உதவுகிறது, மேலும் குறிப்பிடத்தக்க பக்கங்கள் வலைவலம் மற்றும் அட்டவணைப்படுத்தப்படுவதை உறுதி செய்கிறது.

- மேம்படுத்தப்பட்ட இணையதள ஏற்றுதல் நேரம்: முக்கியமற்ற ஆதாரங்களை அணுகுவதில் இருந்து போட்களைத் தடுப்பதன் மூலம், robots.txt சேவையக சுமையை குறைக்கலாம், தளத்தின் ஏற்றுதல் நேரத்தை மேம்படுத்தலாம், இது எஸ்சிஓவில் முக்கியமான காரணியாகும்.

- பொது அல்லாத பக்கங்களை அட்டவணைப்படுத்துவதைத் தடுப்பது: பொது அல்லாத பகுதிகளை (நிலைப்படுத்தல் தளங்கள் அல்லது மேம்பாட்டுப் பகுதிகள் போன்றவை) அட்டவணைப்படுத்தப்படுவதிலிருந்தும் தேடல் முடிவுகளில் தோன்றுவதிலிருந்தும் இது உதவுகிறது.

Robots.txt அத்தியாவசிய கட்டளைகள் மற்றும் அவற்றின் பயன்பாடுகள்

- அனுமதி: தளத்தின் எந்தப் பக்கங்கள் அல்லது பிரிவுகளை கிராலர்கள் அணுக வேண்டும் என்பதைக் குறிப்பிட இந்த உத்தரவு பயன்படுத்தப்படுகிறது. எடுத்துக்காட்டாக, ஒரு வலைத்தளம் SEO க்கு குறிப்பாக பொருத்தமான பகுதியைக் கொண்டிருந்தால், 'அனுமதி' கட்டளை அது க்ரால் செய்யப்படுவதை உறுதிசெய்யும்.

Allow: /public/- அனுமதி: 'அனுமதி' என்பதற்கு நேர்மாறாக, இந்த கட்டளை இணையதளத்தின் சில பகுதிகளை வலைவலம் செய்ய வேண்டாம் என்று தேடுபொறி போட்களுக்கு அறிவுறுத்துகிறது. உள்நுழைவு பக்கங்கள் அல்லது ஸ்கிரிப்ட் கோப்புகள் போன்ற எஸ்சிஓ மதிப்பு இல்லாத பக்கங்களுக்கு இது பயனுள்ளதாக இருக்கும்.

Disallow: /private/- வைல்டு கார்டுகள்: வைல்டு கார்டுகள் பேட்டர்ன் பொருத்தத்திற்கு பயன்படுத்தப்படுகின்றன. நட்சத்திரக் குறியீடு (*) எழுத்துகளின் எந்த வரிசையையும் குறிக்கிறது, மேலும் டாலர் குறி ($) URL இன் முடிவைக் குறிக்கிறது. பரந்த அளவிலான URLகளைக் குறிப்பிடுவதற்கு இவை பயனுள்ளதாக இருக்கும்.

Disallow: /*.pdf$- தள வரைபடங்கள்: robots.txt இல் தளவரைபட இருப்பிடத்தைச் சேர்ப்பது, தேடுபொறிகள் தளத்தில் உள்ள அனைத்து முக்கியமான பக்கங்களையும் கண்டுபிடித்து வலைவலம் செய்ய உதவுகிறது. SEO க்கு இது மிகவும் முக்கியமானது, ஏனெனில் இது ஒரு தளத்தின் விரைவான மற்றும் முழுமையான அட்டவணைப்படுத்தலுக்கு உதவுகிறது.

Sitemap: https://martech.zone/sitemap_index.xmlRobots.txt கூடுதல் கட்டளைகள் மற்றும் அவற்றின் பயன்பாடுகள்

- பயனர் முகவர்: எந்த கிராலருக்கு விதி பொருந்தும் என்பதைக் குறிப்பிடவும். 'பயனர் முகவர்: *' அனைத்து கிராலர்களுக்கும் விதியைப் பயன்படுத்துகிறது. உதாரணமாக:

User-agent: Googlebot- Noindex: நிலையான robots.txt நெறிமுறையின் பகுதியாக இல்லாவிட்டாலும், சில தேடுபொறிகள் புரிந்துகொள்கின்றன a நொயிண்டெக்ஸ் robots.txt இல் உள்ள உத்தரவு, குறிப்பிட்ட URL ஐ அட்டவணைப்படுத்த வேண்டாம்.

Noindex: /non-public-page/- வலம்-தாமதம்: இந்த கட்டளை கிராலர்களை உங்கள் சர்வரில் ஹிட் செய்வதற்கு இடையே ஒரு குறிப்பிட்ட நேரத்தைக் காத்திருக்கும்படி கேட்கிறது, இது சர்வர் லோட் சிக்கல்கள் உள்ள தளங்களுக்கு பயனுள்ளதாக இருக்கும்.

Crawl-delay: 10உங்கள் Robots.txt கோப்பை எவ்வாறு சோதிப்பது

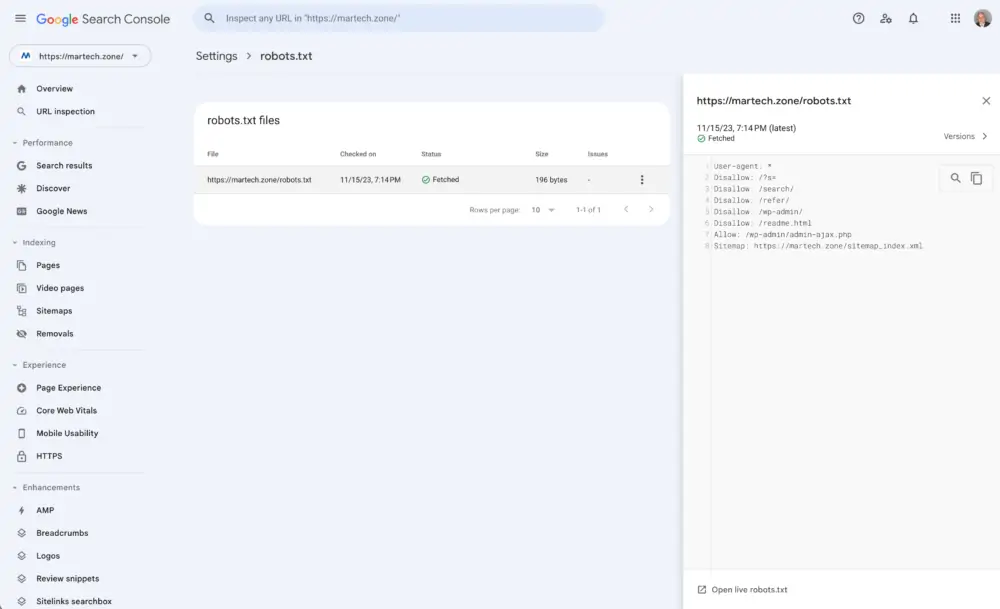

அது புதைந்திருந்தாலும் Google தேடல் பணியகம், தேடல் கன்சோல் robots.txt கோப்பு சோதனையாளரை வழங்குகிறது.

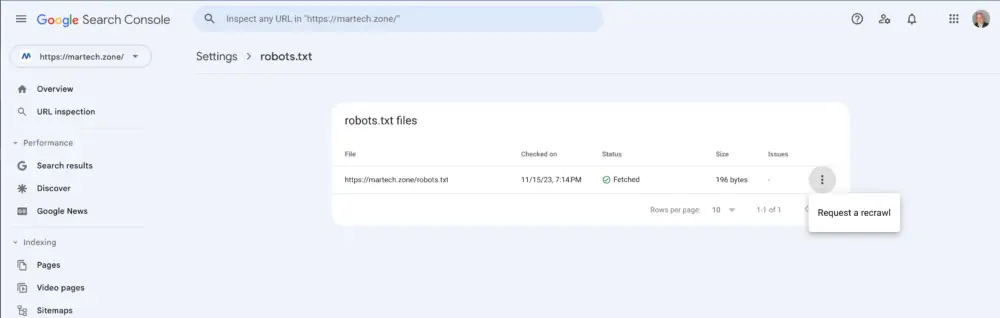

வலதுபுறத்தில் உள்ள மூன்று புள்ளிகளைக் கிளிக் செய்து தேர்ந்தெடுப்பதன் மூலம் உங்கள் Robots.txt கோப்பை மீண்டும் சமர்ப்பிக்கலாம் மீண்டும் வலைவலம் செய்யக் கோரவும்.

உங்கள் Robots.txt கோப்பைச் சோதிக்கவும் அல்லது மீண்டும் சமர்ப்பிக்கவும்

AI போட்களைக் கட்டுப்படுத்த Robots.txt கோப்பைப் பயன்படுத்த முடியுமா?

என்பதை வரையறுக்க robots.txt கோப்பைப் பயன்படுத்தலாம் AI வலை கிராலர்கள் மற்றும் பிற தானியங்கு போட்கள் உட்பட போட்கள் உங்கள் தளத்தில் உள்ள உள்ளடக்கத்தை வலைவலம் செய்யலாம் அல்லது பயன்படுத்தலாம். கோப்பு இந்த போட்களை வழிநடத்துகிறது, அவை இணையதளத்தின் எந்தப் பகுதிகளை அணுக அனுமதிக்கப்படுகின்றன அல்லது அனுமதிக்கப்படவில்லை என்பதைக் குறிக்கிறது. AI போட்களின் நடத்தையைக் கட்டுப்படுத்தும் robots.txt இன் செயல்திறன் பல காரணிகளைப் பொறுத்தது:

- நெறிமுறையைப் பின்பற்றுதல்: மிகவும் புகழ்பெற்ற தேடுபொறி கிராலர்கள் மற்றும் பல AI போட்கள் அமைக்கப்பட்டுள்ள விதிகளை மதிக்கின்றன

robots.txt. இருப்பினும், கோப்பு செயல்படுத்தக்கூடிய கட்டுப்பாட்டை விட ஒரு கோரிக்கையாக உள்ளது என்பதைக் கவனத்தில் கொள்ள வேண்டும். போட்கள் இந்த கோரிக்கைகளை புறக்கணிக்க முடியும், குறிப்பாக குறைவான கவனக்குறைவான நிறுவனங்களால் இயக்கப்படும். - அறிவுறுத்தல்களின் தனித்தன்மை: வெவ்வேறு போட்களுக்கான வெவ்வேறு வழிமுறைகளை நீங்கள் குறிப்பிடலாம். உதாரணமாக, குறிப்பிட்ட AI போட்களை உங்கள் தளத்தை வலைவலம் செய்ய அனுமதிக்கலாம், அதே நேரத்தில் மற்றவர்களை அனுமதிக்க முடியாது. இதைப் பயன்படுத்தி செய்யப்படுகிறது

User-agentஉள்ள உத்தரவுrobots.txtமேலே உள்ள கோப்பு உதாரணம். உதாரணத்திற்கு,User-agent: Googlebotகூகுளின் க்ராலருக்கான வழிமுறைகளை குறிப்பிடும்User-agent: *அனைத்து போட்களுக்கும் பொருந்தும். - வரம்புகள்: போது

robots.txtகுறிப்பிட்ட உள்ளடக்கத்தை வலைவலம் செய்வதிலிருந்து போட்களைத் தடுக்கலாம்; அவர்கள் ஏற்கனவே அறிந்திருந்தால் உள்ளடக்கத்தை அவர்களிடமிருந்து மறைக்காது URL ஐ. கூடுதலாக, உள்ளடக்கம் வலைவலம் செய்யப்பட்டவுடன் அதன் பயன்பாட்டைக் கட்டுப்படுத்த எந்த வழியையும் இது வழங்காது. உள்ளடக்கப் பாதுகாப்பு அல்லது குறிப்பிட்ட பயன்பாட்டுக் கட்டுப்பாடுகள் தேவைப்பட்டால், கடவுச்சொல் பாதுகாப்பு அல்லது அதிநவீன அணுகல் கட்டுப்பாட்டு வழிமுறைகள் போன்ற பிற முறைகள் தேவைப்படலாம். - போட்களின் வகைகள்: அனைத்து AI போட்களும் தேடுபொறிகளுடன் தொடர்புடையவை அல்ல. வெவ்வேறு நோக்கங்களுக்காக பல்வேறு போட்கள் பயன்படுத்தப்படுகின்றன (எ.கா., தரவு ஒருங்கிணைப்பு, பகுப்பாய்வு, உள்ளடக்க ஸ்கிராப்பிங்). இந்த வெவ்வேறு வகையான போட்களுக்கான அணுகலை நிர்வகிக்க robots.txt கோப்பு பயன்படுத்தப்படலாம், அவை REPஐக் கடைப்பிடிக்கும் வரை.

தி robots.txt AI போட்களால் தள உள்ளடக்கத்தை வலைவலம் செய்வது மற்றும் பயன்படுத்துவது தொடர்பான உங்கள் விருப்பங்களை சமிக்ஞை செய்வதற்கான பயனுள்ள கருவியாக கோப்பு இருக்கும். இருப்பினும், அதன் திறன்கள் கடுமையான அணுகல் கட்டுப்பாட்டை அமல்படுத்துவதற்குப் பதிலாக வழிகாட்டுதல்களை வழங்குவதற்கு மட்டுப்படுத்தப்பட்டுள்ளன, மேலும் அதன் செயல்திறன் ரோபோட்கள் விலக்கு நெறிமுறையுடன் போட்களின் இணக்கத்தைப் பொறுத்தது.

robots.txt கோப்பு SEO ஆயுதக் களஞ்சியத்தில் ஒரு சிறிய ஆனால் வலிமையான கருவியாகும். சரியாகப் பயன்படுத்தும்போது, இணையதளத்தின் தெரிவுநிலை மற்றும் தேடுபொறியின் செயல்திறனை இது கணிசமாக பாதிக்கும். ஒரு தளத்தின் எந்தப் பகுதிகள் வலைவலம் மற்றும் அட்டவணைப்படுத்தப்படுகின்றன என்பதைக் கட்டுப்படுத்துவதன் மூலம், வெப்மாஸ்டர்கள் தங்களின் மிகவும் மதிப்புமிக்க உள்ளடக்கம் முன்னிலைப்படுத்தப்படுவதை உறுதிசெய்து, அவர்களின் SEO முயற்சிகள் மற்றும் இணையதள செயல்திறனை மேம்படுத்தலாம்.